A mesterséges intelligenciának a hatalmas adatmennyiségek páratlan gyorsasággal történő feldolgozásában és elemzésében való jártassága nagymértékben növeli a kutatás hatékonyságát, és utat nyit az úttörő felfedezések előtt. A mesterséges intelligencia az új gyógyszerek kifejlesztésétől a környezeti változások előrejelzéséig a különböző tudományos területeken a fejlődés katalizátoraként betöltött kritikus szerepét hangsúlyozza.

Az MI hozzájárulása a tudományos kutatáshoz mélyreható, mivel egyszerűsíti az összetett adatok átalakítását hasznosítható felismerésekké, és felszabadítja a kutatókat a fáradságos feladatok alól, melyek a hatásos kérdések megfogalmazásától az átfogó magyarázó jelentések elkészítéséig terjednek. Az adatkezelés e forradalma megkönnyíti a megalapozott döntéshozatalt és az összetett problémák innovatív megoldásainak létrehozását. Legyen szó akár az alapvető gyógyszerek létrehozásának felgyorsításáról a kémiai vegyületek elemzésével, akár az éghajlati változások előrejelzéséről a környezeti adatok segítségével, a mesterséges intelligencia befolyása kiterjeszti az előrejelzési pontosság, a felfedezés és a kutatás hatékonyságának határait, és átalakító erőként érvényesül a tudás keresésében.

A mesterséges intelligencia gyors integrációja a tudományos erőfeszítésekbe azonban a kihívások összetett sorát hozza magával. Különösen a Nature-ben megjelent „Artificial Intelligence and Illusions of Understanding in Scientific Research” című cikk világít rá a mesterséges intelligencia mindenre kiterjedő alkalmazásával járó kockázatokra. Jelentős aggodalomra ad okot, hogy az MI a termelékenységet a mélyreható megértéssel szemben előtérbe helyezheti, ami olyan forgatókönyvhöz vezethet, melyben a kutatók „többet termelnek, de kevesebbet értenek”.

Bár ez a dilemma a mesterséges intelligencia kontextusában felerősödik, de nem egyedi. Olyan szélesebb körű tudományos kihívásokat tükröz, melyek már jóval azelőtt is léteztek, hogy a mesterséges intelligencia kiemelkedő eszközzé vált volna, beleértve azt a tendenciát, hogy az ok-okozati összefüggések helyett a „jóslást” részesítik előnyben. Az alapvető kihívás tehát abban rejlik, hogy megtaláljuk a megfelelő egyensúlyt a mesterséges intelligencia számítási teljesítményének kihasználása és a kutatás tárgyával való mély elkötelezettség fenntartása között.

A mesterséges intelligencia tudományos kutatásban való felhasználása körüli vita túlmutat az elfogadás és elutasítás közötti egyszerű választáson. Szükség van arra, hogy az MI felelősségteljes és hatékony alkalmazása felé mozduljunk el a tudományos erőfeszítések fokozása érdekében. Az emberi erőfeszítések által vezetett kutatásokhoz hasonlóan a tudományos közösségnek is olyan stratégiákat és elveket kell kidolgoznia és betartania, melyek biztosítják a mesterséges intelligencia kiegyensúlyozott integrációját. Az alapvető intézkedések közé tartozik a megmagyarázható mesterséges intelligenciamodellek létrehozása, az MI-algoritmusokba beépítendő szakterület-specifikus tudás, az etikai normák betartása és a kritikus gondolkodás előmozdítása a kutatók körében. Célzott oktatással és képzéssel a tudósok gyakorlottá válnak az MI-eszközök megfontolt használatában, és az MI-t együttműködő partnerként pozicionálják a tudás feltárásának folyamatában. Lényegében a mesterséges intelligencia kutatásba való teljes integrációjához nemcsak technológiai fejlődésre, hanem hatékony irányításra és a legjobb gyakorlatokra is szükség van.

A tudományos kutatás új korszakába lépve elengedhetetlen, hogy olyan kultúrát alakítsunk ki, mely értékeli mind az MI számítási hatékonyságát, mind az emberi intellektus pótolhatatlan mélységét. Átgondolt irányelvek bevezetésével és a tudományos kutatás holisztikus megközelítésének elfogadásával biztosíthatjuk, hogy a mesterséges intelligencia inkább az emberi meglátások kiegészítését, mintsem kiszorítását szolgálja. Ez a kiegyensúlyozott megközelítés egy olyan jövőt hirdet, ahol a mesterséges intelligencia és az emberi kreativitás egyesíti erőit, kitolva a meglévő tudás határait, és a tudományos eredmények új területeit nyitva meg. Azzal, hogy teljes szívvel elfogadjuk a mesterséges intelligenciát, miközben tisztában vagyunk a vele járó kockázatokkal, egy olyan jövő felé vesszük az irányt, mely tele van felfedezésekkel és innovációval. Egy olyan jövő felé, ahol a mesterséges intelligencia potenciálja teljes mértékben kiaknázható az emberi megértés kiterjesztése érdekében.

Miért fenyegeti az MI által vezérelt kutatás a valódi megértést?

A világ számszerűsítésére és kategorizálására irányuló könyörtelen törekvés kevés helyet hagy az olyan jelenségeknek, melyek ellenszegülnek a könnyű magyarázatnak és kihívást jelentenek a meglévő tudáskereteink számára. A hatékonyság és az adatgyűjtés modern megszállottsága olyan légkört teremt, melyben a mesterséges intelligencia technológiáinak a tudományos kutatásba való elhamarkodott beolvadása nemcsak elkerülhetetlennek, hanem kívánatosnak is tűnik.

Miközben a mesterséges intelligencia az objektivitás és a gyorsaság csábítását kínálja, fennáll a veszélye, hogy az adatok és a reduktív válaszok elsőbbséget élveznek a „nyílt végű” kérdésekkel és a mély megértéssel szemben, melyek az igazi innováció motorjai. Az irányítás és a számszerűsítés e keretén belül a mesterséges intelligencia az egyre nagyobb hatékonyságra és teljesítményre való törekvésünk látszólag elkerülhetetlen következményeként jelenik meg. Az MI integrálása a tudományos kutatásba a modern állapotunkhoz való tökéletes illeszkedésnek tűnik. De vajon túl szépek-e az ígéretei ahhoz, hogy igazak legyenek? Míg egyes tudósok teljes szívvel elfogadják a mesterséges intelligenciát, mások nagyobb óvatosságot és a széles körű alkalmazással járó kockázatok tudatosítását szorgalmazzák.

Messeri és Crockett a Nature magazin cikkében is ezekkel az aggodalmakkal foglalkozva arra figyelmeztet, hogy az MI, bár termelékenységi és objektivitási előnyöket kínál, kihasználhatja kognitív elfogultságainkat, és a ténylegesnél mélyebb megértés illúzióját keltheti. Ez elfojtaná az innovációt, és a tudományos munkát hajlamosabbá tenné a hibákra. Messeri és Crockett a tudományos közösségben a mesterséges intelligenciával kapcsolatban négy különböző víziót azonosít: Orákulum; Helyettesítő; Kvantum és Döntőbíró.

Orákulum

Az MI mint Orákulum a tudományos ismeretek racionalizálását ígéri, hatékony információfeldolgozást és a torzítások lehetséges csökkentését kínálva. Fennáll azonban a veszélye, hogy az adatkezelést a mély megértés elé helyezi, ami a tudományos közösségen belül a tudás illúzióját keltheti.

Helyettesítő

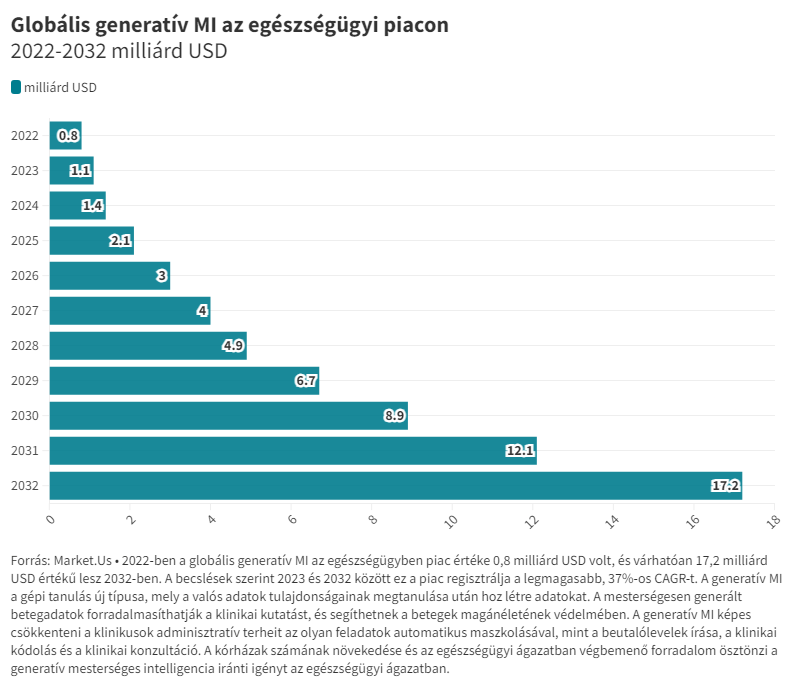

Az MI mint Helyettesítő a drága és időigényes adatgyűjtést generatív mesterséges intelligenciával kívánja helyettesíteni, hatalmas szintetikus adathalmazokat létrehozva. Ez kibővítheti a kutatási lehetőségeket, de csak akkor, ha az MI-modelleket aprólékosan betanítják, hogy elkerüljék az új torzítások bevezetését.

Kvantum

Az MI mint Kvantum célja a nagy mennyiségű adat kezelése, az elemzés automatizálása és a rejtett minták feltárása. Azt ígéri, hogy egyszerűsíti az összetett modelleket, de fennáll a veszélye, hogy a mögöttes folyamatokat elhomályosítja, és a tudományos eredményeket nehezebbé teszi az értelmezést.

Döntőbíró

Az MI mint Döntőbíró az MI mint Orákulum tudásmenedzsment-ígéreteire épít, és a túlterhelt publikációs folyamatok racionalizálására és a replikációs válság kezelésére törekszik. A kéziratok átvilágítására és a recenziók megírására szolgáló eszközöket irányoz elő, melyek potenciálisan csökkentik az elfogultságot, és gyors, szisztematikus értékelést biztosítanak a tanulmányok reprodukálhatóságáról.

Ez a vízió azonban felveti annak a veszélyét, hogy a mesterséges intelligencia hiteles, elfogulatlan bíróvá válik a tudományos döntéshozatalban, és alapvetően megváltoztatja, hogy mit tekintünk érvényes tudásnak. Ezek a víziók azonban a tudományos megértés természetének alapvető változását takarhatják.

A mesterséges intelligencia fausti alkut kínál a tudományos kutatásban: nagyobb hatalom és tudás, cserébe az autonómia finom eróziójáért és annak átalakításáért, amit ma „megértésnek” tekintünk. A hatékonyságra való megszállott összpontosítás elfed egy rejtett veszélyt, melyet a mesterséges intelligencia széles körű alkalmazása rejt magában a kutatási folyamatban. A sebesség és a mennyiség hangsúlyozása elkerülhetetlenül korlátozza a kutatás hatókörét, ami egy korlátozott ontológiához vezet.

A tudósok, akiket elárasztanak az MI által generált adatok, és akiket arra kényszerítenek, hogy a társaikkal azonos ütemben termeljenek, kénytelenek lesznek az MI-víziók egyikét vagy mindegyikét elfogadni, hogy fenntartsák a paritást. Ez egy „ontológiai köteléket” hoz létre a kutatók és az MI-modellek között: egy olyan függőséget, mely finoman áthelyezi az irányítás helyét az emberről a gépre.

Ahogy az MI diktálja a kutatás tempóját és jellegét, a tudományos ismeretek előállítása fokozatosan feladódik, és a tudósok az MI által vezérelt eredmények „puszta ügynökeivé” válnak.

A tanulmány szerzői hangsúlyozzák: A mesterséges intelligencia potenciális előnyeit érdemes komolyan venni, de kritikus fontosságú, hogy a tudósok és a mesterséges intelligencia eszközeinek fejlesztői egy alternatív lehetőséggel is számoljanak: hogy bizonyos körülmények között a mesterséges intelligencia eszközei valójában inkább korlátozzák, mint fokozzák a tudományos megértést. Más szóval, a potenciális episztemikus előnyök mellett az MI orákulumai, helyettesítői, kvantumai és döntőbírái episztemikus kockázatokat is hordoznak, amikor a tudósok tudástermelő partnerként bíznak bennük.

A „Magyarázó Mélység Illúziója” rávilágít arra a veszélyre, hogy a mesterséges intelligencia látszólag objektív válaszokat ad anélkül, hogy megvilágítaná a mögöttes folyamatokat, és ezzel elkerüli a valódi megértést. Továbbá a „Feltáró Szélesség Illúziója” azt mutatja be, hogy a mesterséges intelligenciával kompatibilis adatok iránti igény hogyan korlátozhatja a tudósok által feltett kérdéseket, a kutatást a számszerűsíthető jelenségek irányába terelve. Ezek a korlátok, valamint az »Objektivitás illúziója« (az a téves meggyőződés, hogy az MI eredendően elfogulatlan eredményeket produkál) megerősítik a kutatók és az MI közötti »ontológiai köteléket«.

A mesterséges intelligencia bevonása a tudományos tudásközösségekbe jelentős veszélyt jelent az egész tudományos vállalkozásra. A mesterséges intelligencia vonzereje azon a vélt képességén múlik, hogy az objektivitásra való törekvés során legyőzi az emberi korlátokat: olyan tulajdonságokat, melyek a tudományos bizalom alapját képezik. A „bizalmi ablak” megnyitása a mesterséges intelligencia bevonása előtt megbonthatja a tudásközösségeken belüli kényes egyensúlyt.

A tudósok mesterséges intelligenciáról alkotott elképzelései gyakran úgy mutatják be ezeket az eszközöket, mint „emberfeletti” partnereket, melyek képesek legyőzni az emberi korlátokat, különösen az objektivitás és a mennyiségi elemzés tekintetében. A mesterséges intelligenciának az egyszerű, számszerűsíthető magyarázatok nyújtására való képessége a természetes kognitív preferenciáinkat tükrözi, így ezek az eszközök kivételesen megbízhatónak tűnnek, és elfedik a megértés illúzióinak lehetőségét. Az ilyen illúziók alááshatják a tudományos szigorhoz elengedhetetlen árnyalt, minőségi értékeléseket, mivel a mesterséges intelligencia reduktív, kvantitatív eredményekre való törekvése azzal a kockázattal jár, hogy felváltja az összetett jelenségek valódi megértését.

A kísérletek azt mutatják, hogy az emberek az egyszerű, átfogó, reduktív és mennyiségi válaszokat és magyarázatokat részesítik előnyben. Ezek a tulajdonságok a tudósok mesterséges intelligenciáról alkotott elképzeléseiben is hangsúlyosan megjelennek. Az orákulumokat úgy állítják be, mint melyek egész irodalmak egyszerűsítő összefoglalóit adják; a kvantumokat úgy építik fel, hogy komplex természeti jelenségek kvantitatív modelljeit adják; a helyettesítő modelleket úgy tekintik, mint melyek az emberiség teljes spektrumát képviselik; és az ítélőbírókat úgy javasolják, hogy a tudományos munkát olyan reduktív mérőszámok alapján értékeljék, mint a „minőség” vagy a „megismételhetőség”. Bár a reduktív és kvantitatív magyarázatok általában a megértés érzését keltik, ezek az érzések nem mindig korrelálnak a tényleges megértéssel. Ez a megértés illúziójához vezethet.

A monokultúra veszélye

A monokultúra veszélyei, melyeket tragikusan szemléltetett az 1930-as évek mezőgazdasági válsága intő jelként jelenik meg ebben a kontextusban. Egy tudományos közösség, mely túlzottan egyetlen megközelítésre vagy technológiára támaszkodik, hasonló pusztítást kockáztat. A mezőgazdaságban monokultúráról akkor beszélünk, ha egy gazdálkodó egyszerre csak egy növényfajt termeszt egy területen. Ez hatékony, és a modernitásban ez az egyik vezérelv; mégis mindannyian ismerjük, hogyan pusztított ez a gyakorlat az Egyesült Államok síkságain. Az egyetlen, monokultúrás növénykultúra nélkülözi a talajból az alapvető tápanyagokat a vetésforgó által biztosított regenerációs ciklus nélkül. Ezáltal rendkívül sebezhetővé válnak a kártevőkkel és betegségekkel szemben. Hasonlóképpen, egy olyan tudományos közösség, mely túlhangsúlyoz egyetlen megközelítést, például a mesterséges intelligencia széles körű elterjedését, azt kockáztatja, hogy elhanyagolja a többi módszert, és vakká válik a lehetséges gyengeségekkel szemben.

Az objektivitás idealizált víziója

A mesterséges intelligencia eszközei elősegíthetik a tudományos monokultúrák növekedését az alábbiak révén: (1) a mesterséges intelligencia támogatására legalkalmasabb kérdések és módszerek előtérbe helyezése, ami korlátozza a vizsgálat körét, és (2) a mesterséges intelligencia által kifejezett álláspontok típusainak előtérbe helyezése, ami potenciálisan elhallgattatja a marginalizált vagy eltérő nézőpontokat. Például az MI által generált adatokra erősen támaszkodó kutatások esetében nagy a kockázata annak, hogy elhanyagolják azokat a területeket, ahol az adatok kevésbé számszerűsíthetőek, vagy ahol a marginalizált közösségek nem képviseltetik magukat a felhasznált adatkészletekben. Ez a szűkülő fókusz nemcsak a tudományos eredmények hibáját és torzítását kockáztatja, hanem a megértés elterjedt illúzióját is.

A mesterséges intelligencia által vezérelt objektivitás idealizált víziója felé való törekvés megerősíti az ontológiai kötöttséget. Amikor az MI-t (melyet orákulumként és döntőbíróként képzelnek el), az emberi vezetésű kutatásnál magasabb rendűnek tekintik, mivel a mesterséges intelligencia állítólag képes túllépni az emberi szubjektivitáson, akkor a független, elfogulatlan értékelők archimédeszi eszményének keresése a tudományos szférában veszélyessé válik. A tudományos kutatást tisztán „objektív” folyamattá redukálja, és naivan feltételezi, hogy a szubjektivitás minden nyomának kiküszöbölése mindig jobb tudományhoz vezet. Az objektivitásra való törekvés a mesterséges intelligencián keresztül figyelmen kívül hagyja az emberi sokféleség alapvető szerepét a tudományos fejlődésben. A kognitív sokszínűség biztosítja a kérdésfeltevések, a problémamegoldó stratégiák és az új nézőpontok szélesebb skáláját: mindezek nélkülözhetetlenek a tudományos fejlődéshez.

Gondoljunk csak egy orvosi kutatócsoportra: egy orvosnak a betegekkel kapcsolatos első kézből származó tapasztalatai olyan kutatási irányt indíthatnak el, melyet egy pusztán statisztikai modellekre összpontosító adattudós nem venne soha figyelembe, nem is beszélve egy absztrahált adathalmazon képzett mesterséges intelligenciáról. Itt döntő fontosságú és ami a legtöbb tudományról szóló vitában elveszni látszik, hogy a szubjektív keretek, melyeket az egyes személyek a folyamatba hoznak, nem akadályai a tudományos felfedezésnek, hanem éppen azok a források, melyekből értelmes felfedezések születnek. Ahogy Messeri és Crockett figyelmeztet, egy homogén tudományos közösség, mely az objektivitás e hamis ideáljára támaszkodik, azt kockáztatja, hogy alapvetően korlátozza az értelmes felfedezések lehetőségét, miközben a teljes magyarázat illúziójába burkolózik.

Lehetséges egy másik tudomány?

Isabelle Stengers „Another Science is Possible: A Manifesto for Slow Science” című könyvében számos meggyőző érvet hoz fel, melyek figyelemre méltóan jól illeszkednek a mesterséges intelligencia tudományos folyamatokba való integrálásával kapcsolatban felvetett aggályokhoz. Stengers kritikával illeti az általa »gyors tudománynak« nevezett uralkodó tendenciát: a hatékonyság, a termelékenység és a számszerűsíthető eredmények által vezérelt működési módot. Stenger érvelése kiterjed annak szélesebb körű kritikájára, hogy a kortárs tudomány a neoliberális ideológiák és a piaci erők hatására egyre inkább azokat a kutatási programokat helyezi előtérbe, melyek azonnali gazdasági hasznot ígérnek a spekulatívabb vagy alapvetőbb vizsgálatokkal szemben.

Könyvének bevezetőjében Stengers azzal érvel, hogy a tudósok egyre inkább elszigetelődnek a társadalom többi részétől, és egy „szisztematikus távolságtartást” hoznak létre, ahol a tudományos intézmények, az állam és a magánipar összeérnek. Ez olyan vákuumot hoz létre, ahol a nyilvánosságnak vannak olyan tagjai, akiket ő „műértőknek”nevez, olyan egyéneknek, akik képesek megérteni a tudományos munkát és mérlegelni annak társadalmi hatását. Stengers úgy véli, hogy a művelt tudománynak nemcsak szakembereket, hanem műértőket is kell termelnie. Ezt olyan területekhez hasonlítja, mint a zene, a sport vagy a szoftverek, ahol az alkotóknak mérlegelniük kell, hogyan értékeli és használja majd munkájukat a közönség ahelyett, hogy egyszerűen csak megfellebbezhetetlen tényként tálalnák azt.

Stengers keretrendszere kiemeli a tudósok alapvető felelősségét a hozzáértő közönséggel való kapcsolattartásban. Ez egybecseng azzal a fontossággal, melyet az emersoni és a dewey-i felelősségvállalás koncepciója a nyilvánosság aktív részvételének és elszámoltathatóságának tulajdonít. A mesterséges intelligencia eszközeinek integrálása azonban azzal a kockázattal jár, hogy éppen az ellenkező dinamikát hozza létre, súlyosbítva a „szisztematikus távolságtartást”, melytől ő óva int.

Ahogy a mesterséges intelligencia orákulum, helyettesítő, kvantum és döntőbíró szerepét tölti be, tovább mélyíti a tudósok és a nyilvánosság közötti szakadékot. A veszélyt az jelenti, hogy a nyilvánosság egyre kevésbé lesz képes kritikusan értékelni a mesterséges intelligencia és a kutatók által közösen alakított kutatásokat. Ezáltal a „haladásról” szóló tudományos kijelentések hangtalan fogyasztóivá válnak, és a nyilvánosság még inkább elidegenedik attól, hogy tájékoztassa őket arról, hogy mi számít igazán értékes tudományos tevékenységnek. Végső soron ez az elzárkózás aláássa azokat a társadalmi alapokat, melyeken a tudomány támogatása, legitimitása, sőt a jövőbeli áttörések inspirációja múlik.

Stengers egy hároméves kísérletet indított az egyetemén, melyben a diákok múltbeli tudományos eredményeket elemeztek. Az elemzés során felfedezték azokat a finom módszereket, melyekkel a tudósok olykor „nem tudományos” vagy ideológiai dolgokat, melyeket mások fontosnak tartanak, elhallgatnak. A diákok rájöttek, hogy a tudományos helyzeteket bizonytalanság jellemzi: a tények és értékek hálójába gabalyodva a tudósok döntései alapján szándékosan figyelmen kívül hagyják azokat a szempontokat, melyek kívül esnek az előre meghatározott feltételeken. Ezt a szelektivitást mostanában beleszövik a mesterséges intelligencia modellek logikájába. Ahogy az MI együttműködik a tudósokkal, fennáll a veszélye, hogy ezek az előítéletek exponenciális mértékben súlyosbodnak.

Az olyan tudós mítoszának megalkotása, aki rendelkezik a „megfelelő tulajdonságokkal”: a „tudomány szelleméhez” igazodó, és az olyan állítólagosan nőies tulajdonságoktól, mint a „szenvedély” és a „szeszélyek” mentes beállítottság évszázados veszélyt jelent. Robert Boyle, akit a modern kémia megalapítójának tartanak, a »szellemi tisztaság« etikáját hirdette, melynek középpontjában a szerénység és az ész fegyelmezett gyakorlása állt. A távolságtartó, tökéletesen racionális tudós eszménye még mindig finoman formálja elvárásainkat. Vajon ez magyarázza-e a mesterséges intelligenciába, mint az objektivitás elérésének eszközébe vetett bizalmunkat? Ami azonban ebben a diszpozícióban történik, és ez a kulcs, az az, hogy a »nagy kérdések« (a kutatásunk céljáról, annak következményeiről arra nézve, hogy mit tekintünk jó életnek) azonnal nem-tudományosakká és irrelevánssá válnak. Ez egy elszegényedett ontológiát hagy maga után, melyben az egyik típusú hitet felcseréltük egy másikkal. Mert most már a »megfelelő dolgok« birtoklása (a tudósok ethoszának megtestesítése) megköveteli azt a rendíthetetlen hitet, hogy amit a tudományos kérdések úgy határoznak meg, mint ami nem számít. De ez az, ami valójában nem számít! Ez egy olyan hit, ahogy Stengers mondja, amely »a kétségekkel szemben határozza meg magát«.

A valóság bizonyos részeinek kizárása

A valóság bizonyos, a konkrét kutatási kérdésnek nem megfelelő részeinek kizárása (bizonyos tényezők ideiglenes félretétele, hogy egy problémára összpontosíthassunk) a tudományos kutatás szükséges része. A „megfelelő” tudományos objektivitásnak ez a meghatározása azonban maga is normatív állítás. Ez egy választás, a tiszta, elfogultságtól mentes, emberi szenvedélyeinktől és szubjektivitásainktól elválasztott igazság hazugságába csomagolva. Ahogy Stengers fogalmaz, ez a megközelítés szükségessé teszi „a Nagy Kérdés elutasítását, amely a véleményre csábítana, mely mindig téved”. A mesterséges intelligencia azzal a kockázattal jár, hogy felerősíti ezt a veszélyt. Azt az illúziót keltheti, hogy egy zárójelbe tett, számításokkal tökéletes válasz VAN. A teljes kép, elhomályosítva a tágabb értelemben vett kérdések értékét és a különböző nézőpontok szükségességét.

A laboratórium (legyen szó akár valódi laboratóriumról, akár azokról a terekről, melyekben a tudósok dolgoznak) ma már a termelőerők modern módjába szövődött bele. A hatékonyságra, a sebességre és a versenyelőnyre való könyörtelen összpontosítás termékeny talajt teremt a mesterséges intelligencia ellenőrizetlen integrációjának. A további optimalizálást ígérő mesterséges intelligencia súlyosbítja a tudományt, melyet a kíváncsiság és a mélyebb megértés helyett az instrumentalizált tudástermelés vezérel.

Bármi, ami potenciálisan eltávolíthatja a kutatót ettől az instrumentális gondolkodásmódtól, irrelevánsnak, „időpocsékolásnak”, a kétségek útjának minősül. A kétely ködként, a fóbia mezejeként lappang, ahol a legkisebb gondolkodás, egy „mi lett volna, ha” megzavarhatja ezt a számszerűsíthető eredményekre való könyörtelen törekvést. Ez a megzavarás finom, de potenciálisan romboló megingást okoz az instrumentális racionalitás forgó szférájában. Vajon kockázatot jelent-e a furcsaság felvállalása vagy ebben a megingásban rejlik a bölcsesség?

Miles Davis „So What” című műve nagyon fontos az itteni diskurzus szempontjából. Egészen addig a dalig és lemezig a jazz egyfajta rutinba, egy meghatározott formába rendeződött, ahogyan azt néhány stílusbeli trükkel csinálni kell. Maga Miles volt a „módszer” eredeti megalkotója, mely az ii-V-I váltások és ennek az alaparchitektúrának különböző módosított formáiban nyilvánult meg, melyek mozgást biztosítottak a dallamnak és a váltásoknak, melyeken a szólista „átfújhat2, és melyek feszültséget és feloldást teremtenek. Aztán Miles úgy volt vele, hogy mi most itt fogunk lógni ezen az egy akkordon 16 ütemig. Semmi változás, csak D-dúr 16 ütemig, aztán D#-dúr 16-ig, és vissza. Elég furcsa volt. Ha azt mondjuk, hogy ez a dal és az album felforgatta a zenét, akkor ez még enyhe kifejezés. A Kind of Blue a zenetörténet legkelendőbb jazzalbuma. De mi történik itt? Megtévesztő egyszerűségének kezdeti sokkján túl olyan mély kifejezőerőt kínált, mely mélyen rezonált a hallgatókra. Ez egy olyan kapcsolat a közönség, a »műértő« hallgatók és a szakértők között, mely társadalmi értelemben vett szimbiózisban áll, és mely a furcsaságot értelmes valósággá alakítja át. Ahogyan Stengers érvel Egy másik tudomány is lehetséges című könyvében, a tudománynak is hasonló kapcsolatra van szüksége a közönségével.

Ahelyett, hogy kizárólag a hatékonyságra koncentrálnának, a tudósokat arra kell bátorítani, hogy fogadják el a „furcsaságokat”: a bizonytalanokat, a kételyeket, a periférián lappangó kérdéseket, hogy a dolgok egy kicsit meginogjanak. Ezek azok a területek, ahol az átalakító felfedezések rejtőznek. Az egészséges tudományos etika előmozdítása érdekében azonban át kell hidalnunk a tudósok és a nyilvánosság közötti egyre szélesedő szakadékot.

A virágzó tudományos ethoszhoz nem csak az élen járó tudósokra van szükség, hanem egy elkötelezett közönségre is: olyan ismerősökre, akik aktívan részt tudnak venni a tudományos erőfeszítések nyilvános folyamatában, értékelve és megvitatva azok bizonytalanságait és eredményeit. Miközben integráljuk a mesterséges intelligencia eszközeit a tudományos kutatás szövetébe, használjuk fel erejüket új minták és lehetőségek megvilágítására; ugyanakkor ne feledkezzünk meg a tudományos fejlődés mögött álló végső erőről. A szubjektív „miért”-ről, annak minden megnyilvánuló furcsa formájában.

(Kiemelt kép: Unsplash+)