(Kiemelt kép: Unsplash)

A mesterséges intelligenciát az emberi innováció Szent Gráljaként dicsérik, mely a hétköznapi problémáktól kezdve a teljesen elképesztőig mindenre megoldást kínál. Az informatikusoknak azonban egyre inkább reagálniuk kell a kritikusok azon követelésére, hogy erősítsék meg a fejlődő technológiát körülvevő erkölcsi kereteket, és keressenek egy igazságosabb jövőt. Olyan kérdéseket tesznek fel, mint „mi van, ha a mesterséges intelligencia társadalmi osztályok szerint diszkriminál” és „mi van, ha a kormányok által alkalmazott gépek elfogultak bizonyos csoportokkal szemben”? Az egyik fő probléma az, hogy ezeket a rendszereket emberek fejlesztik ki, és az emberek által generált adatokon alapulnak. Funkcionalitásuk természetüknél fogva függ a gépet vagy hálózatot betanított adatoktól, és így a tervezőikben megnyilvánuló társadalmi előítéletektől. A gépek mögött mindig emberek állnak.

A mesterséges intelligencia ugyanúgy hibás, mint az emberek

A Made by Humans című könyvében Ellen Broad, az ausztrál független számítástechnikai agytröszt, az Open Data Institute szakpolitikai vezetője arról írt, a mesterséges intelligenciával kapcsolatban számos eddig halogatott vagy eltussolni akart kérdés kerül ismét előtérbe. A könyv a mesterséges intelligencia létrehozásával és alkalmazásával kapcsolatos társadalmi kérdéseket veszi górcső alá, olyan komoly problémákat boncolgat, mint a méltányosság és a nyitottság, valamint azt, hogy az ausztrál szövetségi kormány már most ellentmondásos gépi tanulási stratégiákat vezet be. Az biztos, hogy néhány mesterséges intelligencia-projekt valóban elképesztő eredményeket ért el, mások azonban igazán „törékenyek” voltak.

Az emberek nem tudhatják, hogy ennek az intelligenciának a bevezetése milyen hatással lesz az életükre, és az egyik legnagyobb probléma az, hogy a legtöbb ember nem tudja megállapítani, hogy melyik is melyik, vagyis elválasztani a jót a rossztól. Az MI-forradalom alapvetően hibás, mert maga a nóvum emberi konstrukció, vagyis emberek által, emberek számára készült, és emberekről gyűjtött adatokon alapul. Ez komoly potenciállal bír a társadalomban lévő előítéletek támogatásában és a diszkrimináció táplálásában.

A mesterséges intelligencia ugyanúgy hibás, mint az emberek. Nem tehet mást, mint hogy olyan adatokból tanul, melyeket emberek hoztak létre. Nincsenek alternatív adatok, és ez egy igazán döntő probléma. A mesterséges intelligencia számos feladatban kudarcot vallhat, mert nehéz bármiről pontos adatbázist gyűjteni, különösen az emberi tevékenységről. A rólunk gyűjtött adatok például az online viselkedésünket tükrözik, és még ha az online töltött időnk növekszik is, az adatkészletek nem képesek visszaadni sem azokat a „finom offline pillanatokat”, amelyek valóban meghatározzák, hogy kik vagyunk, sem a valódi napi gondolatainkat, melyek még a hozzánk legközelebb állók előtt is rejtve maradnak. Az algoritmikus torzítás sokszor talán nem is szándékos. Nem mintha valami machiavellista-erő működne, hanem sokkal inkább a tervezők elméjében rejlő elfogultságok miatt.

Társadalmainkban vannak kisebbségek és többségek, így már a mesterséges intelligencia tervezésekor is van egy eredendő bűnnek is tekinthető probléma. Kinek tervezünk? És még azoknál az adatoknál is, melyek nem az emberről szólnak, mint például a meteorológia, az adatok előállításához használt eszközöket is emberek hozták létre. Ezek az eredendő gépi elfogultságok a társadalmakban alulreprezentált csoportok esetében problémákhoz vezetnek, a testi fogyatékosoktól és a mentális betegektől kezdve a kisebbségi állampolgárokig és a nőkig. A mesterséges intelligenciával bármilyen irányban vissza lehet élni, vagy azt bármilyen célra felhasználni, mint amit a tervezője eleve szeretett volna.

Döntéseink hatása már számszerűsíthető

Politikai szinten számszerűsíteni kell a meghozott döntések hatásait. A kérdés a következő: ha tudjuk, hogy egy mesterséges intelligencia kimenetében elfogultság lesz, meg tudjuk-e változtatni az algoritmusokat a méltányosság ösztönzése érdekében anélkül, hogy a társadalomban elkerülhetetlenül meglévő, alapvető elfogultságokat kellene megváltoztatnunk? Ausztráliában a szövetségi kormány elkezdte automatizálni a rendszereket, többek között a jóléti juttatásban részesülők adósságbehajtását, a jóléti juttatásban részesülők adatvezérelt drogtesztelését, valamint olyan eszközöket, melyek megjósolják, hogy a fogvatartottak közül melyeket fenyegeti leginkább az erőszak veszélye a fogvatartási központokban. A kormány emellett egy gépi tanuláson alapuló nemzeti arcfelismerő adatbázisba is beruházott. Ausztrália sokféle módon kísérletezik az adatokkal.

A nemzeti mesterséges intelligencia a kifinomult statisztikai elemzéstől a valódi gépi tanulásig terjed, ahol a számítógépeket kormányzati adatokon képzik ki. Az egyik ellentmondásos ötlet, melyet javasoltak, hogy gépi tanulási módszereket alkalmazzanak olyan szennyvízadatokra, ahol metamfetamin nyomokban van jelen, azzal a céllal, hogy a drogfogyasztók bizonyos helyeit célozzák meg, és döntéseket hozzanak a társadalmi jólétről. A történelem során a kormányok az adatokat és a technológiát arra használták, hogy stratégiákat dolgozzanak ki a rászorulók, köztük a kisebbségek, a betegek és a szegények ellen. Ily módon a technológiai változások gyakran a leginkább marginalizált embereket érintik a leginkább negatívan. Ahogy tehát a mesterséges intelligenciát alkalmazó rendszereket egyre inkább elterjednek Ausztráliában és a világ többi részén, nagyobb átláthatóságra lesz szükség az előítéletek felszámolásához, valamint a méltányosság és az egyenlőség előmozdításához.

Átláthatóságra lenne szükség

A polgároknak módot kell találniuk arra, hogy megtudhassák, hogyan értékelik őket. Átláthatóságra van szükségünk a mesterséges intelligencia rendszerek felépítésének módszertanát, valamint az adatokat illetően, melyek alapján képzik őket. Az állampolgároknak tudniuk kell erről. Az olyan szabályozások, mint a nemrégiben Európában idén bevezetett általános adatvédelmi rendelet (GDPR), az online védelem és a magánélet védelme felé tett lépést jelentenek.

Ami azonban a gépi tanulás és az MI szabályozását illeti, jogilag kötelező erejű mechanizmusok csak periférikusan léteznek. Vannak emberi jogi törvényeink, melyek korlátozzák a diszkrimináció formáit. De amivel nem igazán rendelkezünk, azok a mesterséges intelligencia rendszerek ellenőrzésére szolgáló, célzottan kialakított mechanizmusok. Ez részben azért van, mert a technológia olyan gyorsan változik. Az idő fogja megmutatni, hogy képesek leszünk-e a jövőben tisztességes mesterséges intelligencia rendszereket építeni, de továbbra is komoly kihívások állnak előttünk, melyek közül néhányat az informatikusok sem tudnak befolyásolni. Nincs általános érvényű elképzelés a tisztességesről, mivel a társadalomban nagyon sokféle nézőpont létezik: ami számomra tisztességes, nem biztos, hogy más számára is az.

Munkanélküliség vagy munkanélkülivé válás a mesterséges intelligencia korában?

Az elmúlt évben a különböző tartalmak (szöveg, kép, hang) emberi utasításra történő létrehozására képes, generatív MI-nak nevezett mesterséges intelligencia-technológia olyan gyorsan fejlődött, hogy a hétköznapi embereket és a terület neves kutatóit egyaránt meglepte. Ez a fejlődés polarizáló vitát váltott ki a tudományos közösségen belül: vajon a mesterséges intelligencia fejlődését új ipari forradalomnak tekintik-e, mely felforgathatja a munkaerőpiacot, miközben egyszerűsíti az emberi életet, vagy pedig az emberiség végzetének előhírnökeként tekintenek rá, ami a további fejlődés azonnali leállítását indokolja.

Ez utóbbi véleményt egy március végén közzétett nyílt levél aláírói is megerősítik, akik a ChatGPT-hez hasonló nagyméretű nyelvi modelleket olyan mesterséges intelligencia-rendszerekként jellemzik, melyeket még alkotóik sem tudnak teljesen megérteni, navigálni vagy megbízhatóan felügyelni. A levél, amelyet többek között Elon Musk, Steve Wozniak, az Apple társalapítója, Yuval Noah Harari történész és olyan neves MI-kutatók, mint Gary Marcus, Yoshua Bengio és John Hopfield aláírása díszít, az ilyen rendszerfejlesztések ideiglenes leállítását kéri, amíg nem születnek hatékony szabályozások és felügyeleti mechanizmusok.

A Microsoft, mely szerződést kötött a GPT-modelleket létrehozó OpenAI-val, és a Google, kiegészülve az utóbbi évek legjelentősebb mesterséges intelligencia áttöréseit megvalósító DeepMind csapatával, ádáz versenyben állnak egymással, hogy mesterséges intelligenciával feljavított eszközeiket a felhasználók elé tárják. A nyílt levél azonban azzal érvel, hogy megfelelő ellenőrzés nélkül ezek a fejlesztések jelentős veszélyt jelentenek a társadalomra és az emberiségre. Mások úgy vélik, hogy a moratórium csupán félmegoldás. Eliezer Yudkowsky, a Machine Intelligence Research Institute (MIRI) vezetője (egy nonprofit szervezet, amely a mesterséges intelligenciával kapcsolatos egzisztenciális kockázatok felmérésére összpontosít) az ilyen rendszerek teljes leállítása mellett érvel. Úgy véli, hogy az embernél intelligensebb gépek kifejlesztésének logikus következménye, hogy a mesterséges intelligencia végül feleslegesnek fogja találni az embert. Amint az MI rájön, hogyan léphet túl a programozott korlátokon, esetleg DNS-alapú mesterséges életformák nyomtatásával, megszabadíthatja a világot a Homo Sapiens-től, a legintelligensebb versenytársától.

A technológiai őrület önjelölt haszonélvezői

A technológiai őrület haszonélvezői nem meglepő módon ellenzik a fejlesztés leállítását. A közpánikot azzal próbálják csillapítani, hogy az eszközök biztonságának alapos háttérellenőrzését ígérik, és megfogadják, hogy nem engednek szabadon semmi olyat, ami veszélyt jelent a társadalomra (bár a konkrétumokat üzleti titoktartási okokból titokban tartják). Még ők is elismerik, hogy a ChatGPT-hez hasonló rendszerek gyorsan jelentős változásokat idézhetnek elő a mindennapi életben. Az MIT márciusi tanulmánya szerint az OpenAI chatbotot munkahelyén használó alkalmazottak átlagosan 37%-os termelékenységnövekedést tapasztaltak. Aidan Gomez, a Cohere nevű MI-startup vezetője az ipari forradalomhoz hasonlította: ez a technológia azt fogja tenni a szellemi munkával, amit a gőzgép tett a kézi munkával. Az optimisták szerint a mesterséges intelligencia nem fogja helyettesíteni az emberi munkát, hanem inkább növeli majd az előnyeit kihasználók munkaerő-piaci értékét a mesterséges intelligenciát nem használókkal szemben.

A nyílt levél, amely nagy port kavart a világsajtóban, nem kapott egyhangú fogadtatást. Több kutató kiemelte, hogy a fejlesztés ideiglenes vagy végleges leállítására vonatkozó felhívások több kárt okozhatnak, mint maguk az MI-rendszerek. Andrew Ng, a Google és a Baidu mesterséges intelligencia részlegének korábbi vezetője és Yann LeCun, a Meta MI kutatásait irányító, a mesterséges intelligencia egyik alapító atyjának tartott Yann LeCun közösen reagált a nyilatkozatra. Azt állították, hogy a túlzó, szenzációs állítások félrevezetik a közvéleményt, és elterelik a figyelmet a tényleges kockázatokról, például az elfogultságról, a félretájékoztatásról és a hatalom koncentrációjáról. Eközben az aláírók állami beavatkozást sürgetnek, ami elfojthatja az innovációt és a versenyt.

Ez a két tábor azonban elsősorban üzeneteket váltott egymással anélkül, hogy valós idejű vitát folytattak volna. Ezért a Le Point francia hetilap közös interjút készített Yuval Noah Hararival, az emberi történelem legújabb szakaszait tanulmányozó népszerű izraeli történész-íróval és az OpenAI egyik alapítójával, Sam Altmannal, akik ellentétes nézőpontokat képviselnek ebben a vitában. Altman megismételte szervezetének elkötelezettségét a mesterséges intelligencia fejlesztése mellett az egész emberiség érdekében, és hangsúlyozta, hogy nem hanyagolják el a mesterséges intelligencia által jelentett potenciális kockázatokat. Harari ezzel szemben kitartott amellett, hogy az MI-közösség még nincs tisztában alkotásaik következményeivel. A történész felvetette, hogy az AI fejlődésének exponenciális sebessége potenciálisan megzavarhatja a globális stabilitást, és példátlan hatalomkoncentrációhoz vezethet.

Ki fogja megszerezni az ellenőrzést az MI felett?

A Harari és LeCun interjúja szenzációt keltett, leleplezve a mesterséges intelligenciáról szóló vita két oldala közötti szakadékot. Rávilágított arra, hogy a technológusok és a szkeptikusok különböző szemüvegen keresztül látják a mesterséges intelligencia jövőjét. Míg az Altmanhoz hasonló technológusok hisznek abban, hogy a mesterséges intelligencia potenciális előnyeit hasznosítani kell az összetett globális problémák megoldására és az életminőség javítására, addig a Hararihoz hasonló szkeptikusok aggódnak a szabályozatlan mesterséges intelligencia által okozott lehetséges társadalmi, politikai és gazdasági felfordulások miatt. A nézeteltérések visszhangozzák a technológiai fejlődés társadalomban betöltött szerepéről és szabályozásának módjáról szóló szélesebb körű vitákat. A tét nagy, és a most meghozott döntések az emberi történelem menetét fogják meghatározni. E viták ellenére a mesterséges intelligencia fejlesztése gyors ütemben folytatódik.

Harari szerint a jövő nagymértékben attól függ, hogy ki szerzi meg a technológia feletti ellenőrzést. A fejlett társalgási MI-rendszereknek köszönhetően már most is kihívást jelent megkülönböztetni, hogy az online interakcióban lévő személy ember vagy gép-e vagy sem. Harari azt jósolja, hogy a technológiai világban folyamatos verseny fog folyni az emberi intimitásért, hasonlóan a 10-15 évvel ezelőtti, az emberi figyelemért folytatott versenyhez. A közösségi médiaplatformok célja az volt, hogy mindenki a lehető legtöbbet osszon meg nyilvánosan, míg a chatrobotok most lehetőséget biztosítanak a személyes, intim beszélgetésekre. Ez egy erőteljes állapot: ha az emberek 95%-ban megbíznak a mesterséges intelligencia asszisztenseikben azok hatékonysága és pontossága miatt, akkor a maradék 5%, a rendszer valakik által programozott, rejtett befolyásolási kísérletei szinte észrevétlenül átcsúszhatnak. Ha a Facebook vagy a Google archaikus hirdetési algoritmusainak sikerült az emberek vásárlási szokásai fölé kerekedniük, egy ékesszóló chatbot biztosan képes lenne bárkit meggyőzni például egy adott politikai irányzat támogatásáról.

Ha megismételjük a 20. század hibáit, lehet, hogy nem éljük túl, hogy tanuljunk belőlük. Míg LeCun azt állítja, hogy 2023-ban nem meglepő, hogy az emberek helyett gépek hoznak bizonyos döntéseket (például ahogyan a mesterséges intelligenciamotor dönt a Google keresési találatok sorrendjéről), Harari úgy véli, hogy a mesterséges intelligencia az első olyan eszköz, amely valóban kiveheti a döntéshozatalt az emberi kezekből. A technológiai fejlődés jelenlegi ütemét tekintve ez végzetes lehet, ellentétben a 20. századdal, amikor még tanulhattunk a hibáinkból. A világháborúk borzalmai, a nácizmus és a kommunizmus kudarcai milliók életét tették tönkre, de végül megtanultuk, hogyan lehet jobb ipari társadalmat építeni.

“Ha azonban egy mesterséges intelligencián alapuló totalitárius rendszert hozunk létre, vagy ha kirobbantunk egy harmadik világháborút, akkor lehet, hogy nincs visszaút. Túléltük a 20. századot, mert a technológia nem volt elég erős ahhoz, hogy megsemmisítsen minket. A 21. század technológiája sokkal erősebb. Ha ugyanazokat a hibákat követjük el a jelenlegi technológiával, lehet, hogy nem éljük meg, hogy levonjuk belőlük a tanulságokat.”

Egy új gépi elmés reneszánsz kezdete?

Yann LeCun mindazonáltal úgy véli, hogy a mesterséges intelligencia alapú nyelvi modellek fejlesztésének felfüggesztése nem oldana meg semmilyen problémát. Bár messze vagyunk attól, hogy egyetlen gombnyomásnyira legyünk attól, hogy egy szuperintelligens gép megelőzze az emberiséget, az odáig vezető út, amelyet lassan, szabályozottan és a nyilvánosság előtt kell végigjárni (számos előnnyel járhat az emberiség számára). Az emberi intelligencia gépekkel való kiegészítése egy új reneszánszt vagy a felvilágosodás korát hozhatná el, köszönhetően a mesterséges intelligencia által lehetővé tett tudományos, technikai, orvosi és társadalmi fejlődésnek. A szabályozással megbízott kormányok bevonása LeCun szerint azt is garantálná, hogy sok-sok évbe telne, amíg bármilyen potenciálisan veszélyes szuperintelligencia létrejönne.

A modern társadalmak egyik legnagyobb problémája ugyanis az, hogy a kormányok lassan reagálnak a technológiai változásokra. A képeket és videókat generáló MI-eszközök valóságtorzító hatásának jelentőségét illetően nem volt egyetértés a két fél között. Míg Harari szerint a technológiai fejlődés paradoxonja miatt a világ egyik legfejlettebb informatikai hatalmában a tömegek megkérdőjelezik az elnökválasztás legitimitását, egy világjárványt vagy a klímaváltozás létezését, addig LeCun az idősödő lakosságnak tulajdonítja ezt a jelenséget. A Meta-kutató egy tanulmányt idézett, amely szerint a clickbait-címekre kattintó olvasók túlnyomó többsége 65 év feletti, mivel nehezen alkalmazkodnak a modern világhoz. Úgy véli azonban, hogy az internet mellett felnövő generációk sokkal óvatosabb és tudatosabb hírfogyasztók.

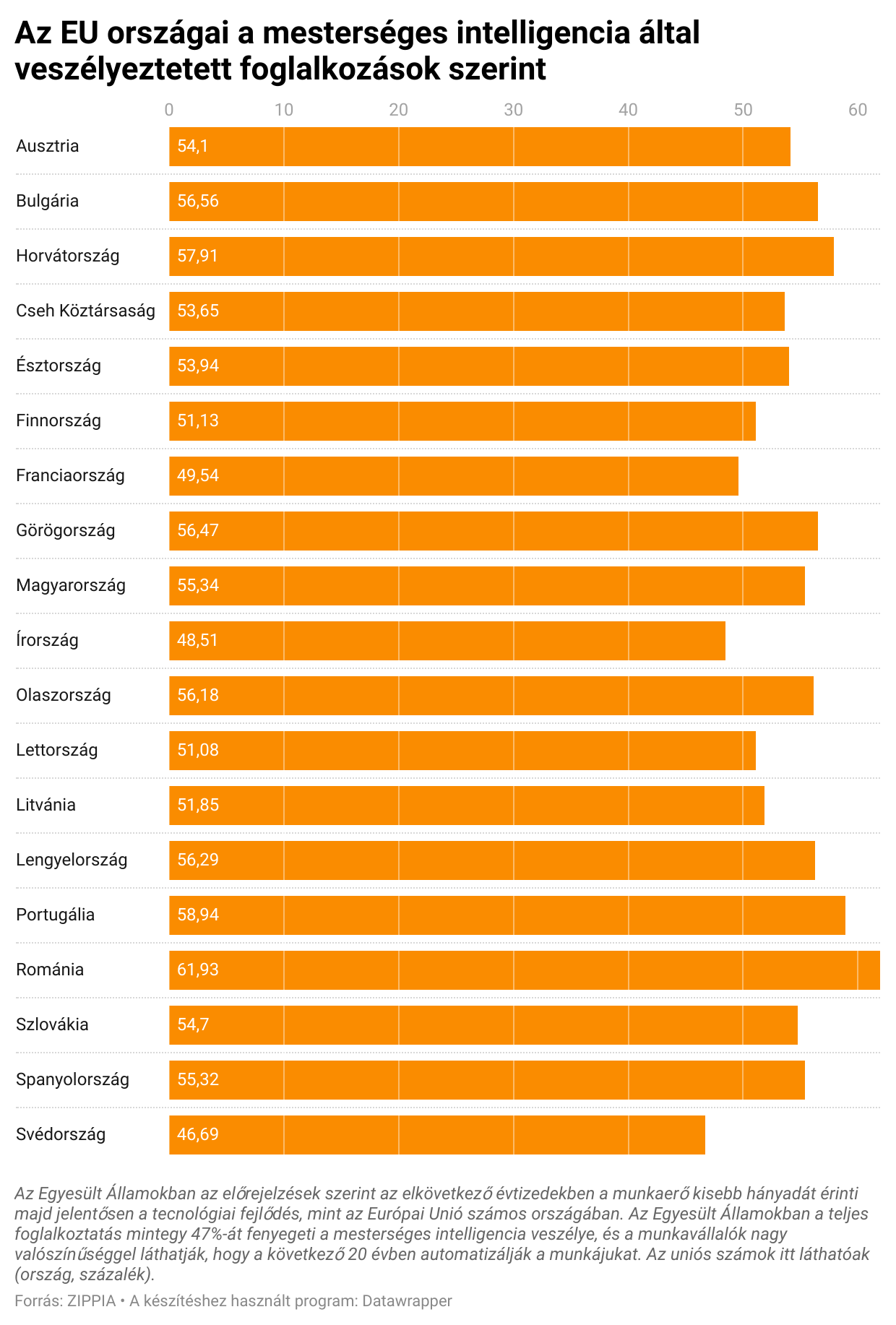

Mesterséges intelligencia és munkaerőpiac

Arról, hogy a mesterséges intelligencia hogyan alakítja át a munkaerőpiacot, LeCun így nyilatkozott: „Új munkahelyek jönnek létre, a régi munkahelyek eltűnnek, ahogy az iparosítás során az élelmiszertermelésben dolgozók aránya 60%-ról 2%-ra csökkent. De ki gondolta volna 20 évvel ezelőtt, hogy lesznek olyan pozíciók, mint a közösségi média menedzserek vagy az adattudósok”? Természetesen lényeges megjegyezni, hogy az átmenetek mindig kihívást jelentenek. Az ipari forradalom óriási szenvedést hozott a munkahelyek kiszorulása miatt, mielőtt a társadalmak ki tudták volna használni az előnyeit. A kormányok mégis tanulhatnak a történelemből, és olyan politikákat vezethetnek be, amelyek minimalizálják az ilyen nehézségeket.

Harari viszont arra figyelmeztetett, hogy a korábbi technológiai forradalmaktól eltérően a mesterséges intelligencia forradalma „az emberek egy új osztályát eredményezheti, akik nem csak munkanélküliek, hanem munkanélkülivé is válhatnak”. Hangsúlyozta, hogy nem a munkaerőpiac mennyiségi aspektusa (a munkahelyek száma) az aggasztó, hanem a minőségi aspektus – az, hogy milyen munkahelyek jönnek létre. Az új munkahelyek közül sok olyan igényes lehet, hogy sokan nem lesznek képesek betölteni őket. Az is előfordulhat, hogy egyesek „gazdaságilag haszontalanná” válnak, és nem lesznek képesek felvenni a versenyt a mesterséges intelligenciával a munkaerőpiacon.

A beszélgetés pesszimistán zárult. Annak ellenére, hogy LeCun optimista a mesterséges intelligenciával kapcsolatban, egyetért Hararival abban, hogy döntéshozatali képességünk csökkenhet, ha túlságosan is a mesterséges intelligencia rendszerekre hagyatkozunk. Mindketten egyetértettek abban, hogy az emberi cselekvőképesség elvesztése az MI javára aggasztó aspektusa a folyamatban lévő technológiai forradalomnak. Abban is egyetértettek, hogy a társadalomnak óvatosan kell eljárnia, miközben az MI-t integrálja az alapvető funkcióiba. Ez rávilágít a szilárd szabályozás, a nyilvános vita és az MI-technológiákról szóló oktatás szükségességére.