A nagy nyelvmodellek (large language models, LLM) a generatív mesterséges intelligencia forradalmának fundamentumai sajnos nem jók a matematikában. Nincsenek egyedül, mert az embereknek is meggyűlik a bajuk, ha fejben kell például nagy számokat osztaniuk, szorozniuk.

Mit teszünk ilyen esetekben? Mondjuk tollat és papírt fogunk, vagy még inkább okostelefonunk számológépére bízzuk a műveleteket. Ha viszont az első lehetőséget választjuk, lépésről lépésre haladva, az egészet részfeladatokra bontva jutunk el a megoldásig.

Mennyi 123-szor 321?

A Szingapúri Nemzeti Egyetem két kutatója új módszert dolgozott ki a nagy nyelvi modellek aritmetikai feladatmegoldásának finomhangolására. Ezek a modellek addig jól adnak össze, vonnak ki, szoroznak és osztanak, amíg egyjegyű számokkal vagy tízzel dolgoznak. Ha viszont nagyobb számokról van szó, gyakran hibáznak.

Esetükben is működik a feladatok részfeladatokra bontása. Viszonylag könnyű olyan nagyobb számok, mint mondjuk 123 és 321 szorzásának tízes egységekre bontása, azaz 123 = 100 + 30 + 3, majd a többi szám megszorzása velük: 100 x 321 + 20 x 321 + 3 x 321. A részeredmények összeadásából megvan a végeredmény: 32100 + 6420 + 963 = 39483.

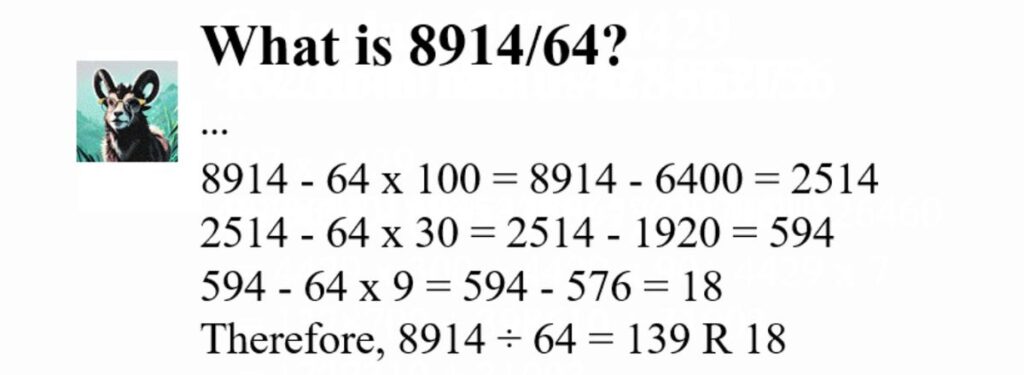

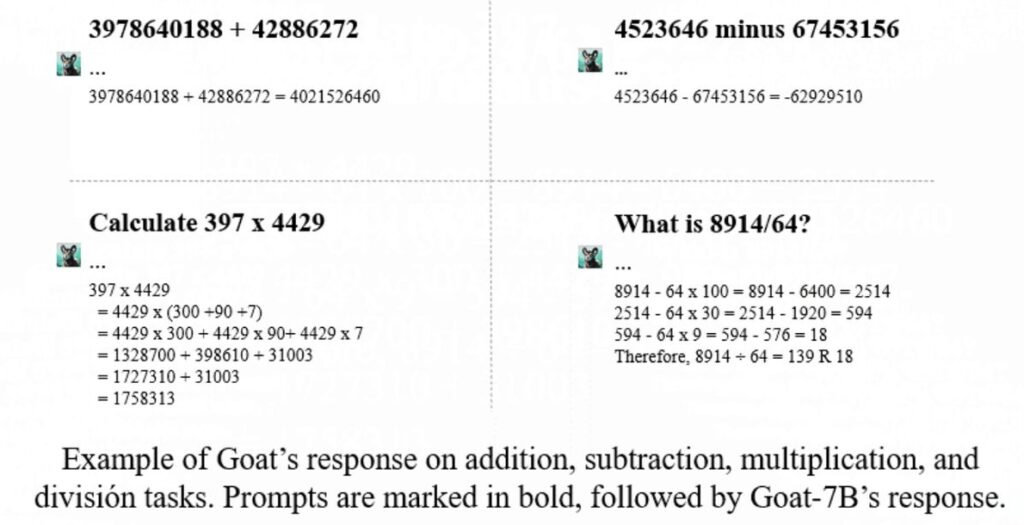

Osztásra is létezik hasonló technika. Ezek a megközelítések együtt lehetővé teszik, hogy az LLM-ek bonyolultabb matematikai feladatokat oldjanak meg.

A kutatók által kidolgozott GOAT (GOod at Arithmetic Tasks) a LLaMA egymillió számtani műveletet tartalmazó adatkészleten finomhangolt változatán alapul. A műveleteket a könnyebb számítások érdekében lépésekre bontották.

A promptok egyszerű utasítások, például számold ki, hogy mennyi 397 x 4429. A válaszok vagy számok (egyszerűbb műveleteknél) vagy következtetés-sorozatok. Utóbbiakhoz Python-szkriptet írtak. Szorzáshoz a szkript véletlenszerűen generál két számot, egy számot tizedesjegyekre oszt, a második számot mindegyikkel megszorozza, és az eredményeket összeadja. Osztásnál is hasonló módszer működik.

Jobban számol mint a GPT-4

A szingapúri kutatók összehasonlították a GOAT-ot és a GPT-4-et. Az összehasonlítást a legfeljebb öt számjegyű egész számokra vonatkozó aritmetikai műveleteket tartalmazó BIGBench-en végezték. A GOAT minden műveletnél vagy ugyanúgy, vagy jobban teljesített, mint a nagy számok szorzásával és osztásával különösen szenvedő GPT-4.

Mit jelent mindez? Például azt, hogy az LLM-ek talán mégsem annyira gyengék matekból, mint gondolnánk, de még inkább, hogy a feladatok racionalizálásával, részfeladatokra bontásával jobban boldogulnak. Természetesen rendelkeznek matematikai ismeretekkel, ez a tudás viszont „szunnyad” bennük, de gondos és alapos finomhangolással felszínre hozható. Mindenki jobban jár vele.

(Képek: DeepLearning.AI, Unsplash)